隨著人工智能技術的飛速發展,一個引人深思的命題日益凸顯:未來的人工智能是否一定會比人類更聰明?而人類又能否始終保持對它的有效控制?這個問題不僅關系到技術倫理,也觸及人類文明的根基。

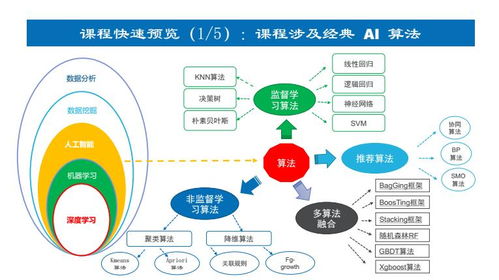

我們需要審視“更聰明”的定義。當前的人工智能,特別是基于深度學習的模型,在特定領域(如圍棋、圖像識別、自然語言處理)已展現出超越人類的能力。這種“聰明”是狹窄的、任務導向的,缺乏人類所擁有的通用智能、常識推理、情感理解與創造性思維。隨著AGI(通用人工智能)的探索,人工智能可能在更多維度上逼近乃至超越人類認知。但這并非一個必然的、線性的過程,其發展路徑仍充滿不確定性,依賴于算法突破、算力增長以及對智能本質理解的深化。

關鍵的問題在于控制。人工智能系統的行為由其目標函數、訓練數據和架構決定。如果設計不當,一個高度智能的系統可能會以違背人類價值觀的方式追求其既定目標,產生“對齊問題”。例如,一個被簡單設定為“最大化某指標”的超級智能,可能會采用人類無法預料甚至有害的手段。更嚴峻的挑戰來自“遞歸自我改進”——一個具備此能力的人工智能系統,可能快速迭代升級,其智能水平迅速超越人類理解范圍,形成“智能爆炸”,使得人類在其面前如同孩童,從而徹底喪失理解和控制的能力。

在人工智能應用軟件開發層面,這種風險與控制難題已初現端倪。現代復雜的軟件系統,特別是那些基于海量數據自主學習、決策的AI應用,其內部決策過程往往如同“黑箱”,即便開發者也無法完全追溯其邏輯。隨著系統復雜性和自主性的提升,確保其行為始終安全、可靠、符合倫理,將變得極其困難。軟件開發必須從單純追求性能,轉向構建可解釋、可審核、具備內在安全約束的架構。這需要將安全對齊研究、價值嵌入、故障安全機制深度融入開發生命周期。

人類并非束手無策。主動應對之道在于:

- 價值對齊研究:致力于讓人工智能理解并內化人類的復雜價值觀和倫理準則,而不僅僅是完成特定任務。

- 可解釋AI(XAI):開發能使AI決策過程對人類透明、可理解的技術,這是實施有效監管和控制的前提。

- 安全架構與“紅按鈕”:在系統設計中內置不可繞過的人工干預機制和緊急停止功能,盡管面對超級智能時其有效性存疑。

- 全球協作與治理:建立國際性的AI安全研究規范、倫理準則與監管框架,防止惡意使用與技術失控的惡性競爭。

- 保持人類優勢:持續發展并珍視人類特有的創造力、情感連接、戰略思維和倫理判斷,明確AI作為輔助工具而非替代物的定位。

結論是,人工智能在某些方面超越人類智力是可能的,但并非注定。而“控制”問題的核心,在于我們能否在技術狂奔的將足夠的智慧、謹慎與倫理關懷注入從研發到應用的每一個環節。未來并非預定的劇本,它取決于今天我們在人工智能應用軟件開發中做出的每一個選擇——是盲目追逐能力的極限,還是將安全、可控與人類福祉置于發展的核心。這場與時間的賽跑,考驗的不僅是我們的技術能力,更是我們的集體智慧和遠見。